AI規制の動向 およびAIの信頼性向上のためのアプローチ

AIの技術革新が急速に進み、世界各国の規制環境も大きく変化する中、企業はどのようにAIと向き合うべきなのか。

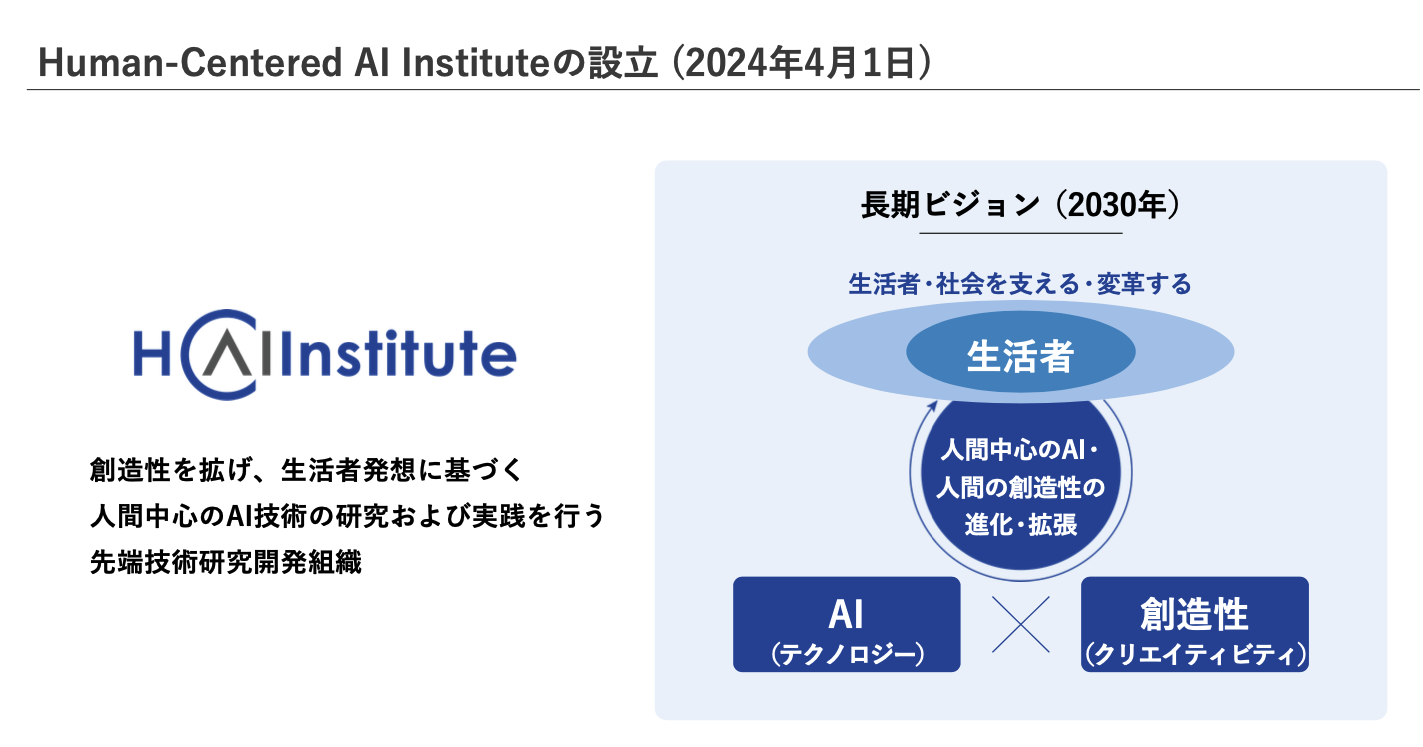

因果推論AIの登場から人間中心のAI活用まで、2025年4月、博報堂DYホールディングスのHuman-Centered AI Institute(以下、HCAI)の代表、森正弥が東京広告協会の法政委員会勉強会で「AI規制の動向およびAIの信頼性向上のためのアプローチ」をテーマに行った講演内容をレポート形式で紹介する。

推論AIによる革新

2024年9月にOpenAIがO1というシリーズのAIを出した。これはチャットGPTの生成AIとは異なるAIである。OpenAIもチャットGPTではなく、O1と呼んで区別している。

生成AIは問いに対して最もありえそうな答えを返すAIであるが、このO1は推論AIである。つまり、最もらしいことをパッと答えるのではなく、確かな根拠に基づいてその根拠から論理を組み立てていき、その問題を解いていくということを行う。

例えば、三次方程式の解を求める問題を渡すとうんなり解く。三次方程式は高校3年の最後の方で扱う内容で、答えの中に虚数解が入っていることもあるため、判別式Dというのが登場してくるのであるが、それを使いながら問題を解いている。教科書通りの綺麗な解法だ。さらには、複雑な東大や京大の数学の入試問題を渡しても明解に解いてしまう。 AIはかなり別の次元に行ってしまったという印象である。

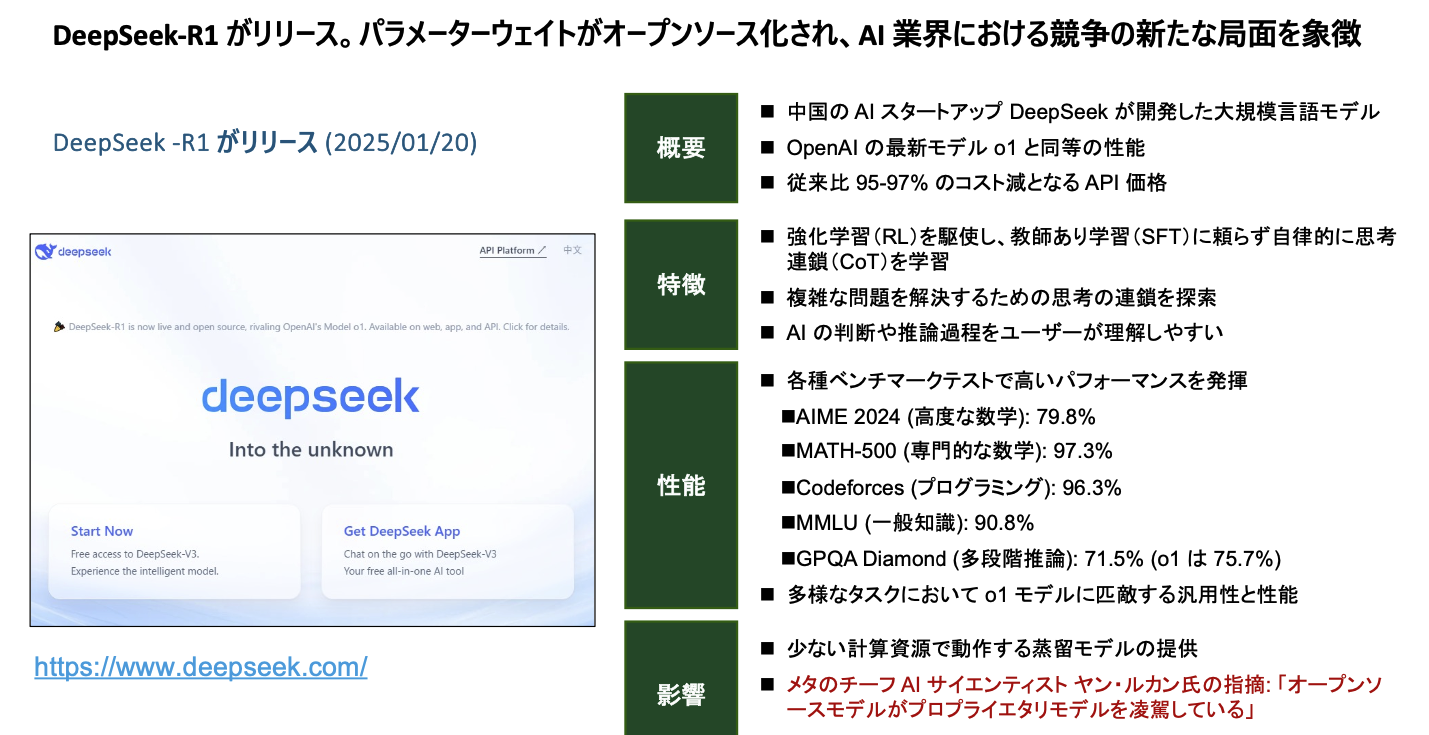

そして、2025年1月に中国のスタートアップDeepSeekがR1というのを出した。OpenAIのO1モデルと同等の性能を出していると、しかもすさまじく低いコストでそれを作り上げているということで話題になった。

AI開発はアメリカだけではなく我々でもできるのだ、というような形で、東南アジアやインド等、アジアパシフィックのAIコミュニティはとても盛り上がった。

このDeepSeekの話は強烈であり、どうやって安いコストでそれを作っているかという話を掘っていくと、さらに凄いことが分かる。NVIDIAのGPUを使うのにあたって同社が提供しているCUDA(クーダ)という開発環境がある。その開発環境を多くの開発者が使いながらGPUを操作するのであるが、このDeepSeekはCUDAを使わずに直接GPUの半導体を操作して最適化しているということを行なって、大幅にコストを下げているということが分かってきている。

これは衝撃的な話として受け止めることができる。中国では国外サービスの利用が難しい中で、そういうことができる技術者を育てていて、第二のスプートニックショックと言われるほどの話で、AIによる国家主権確立、や国家のAI政策のあり方という「Sovereign AI」論の活発化につながっている。

AIに関わる規制動向

AIの急速な進化とともに、AIに関する規制動向についても述べる。

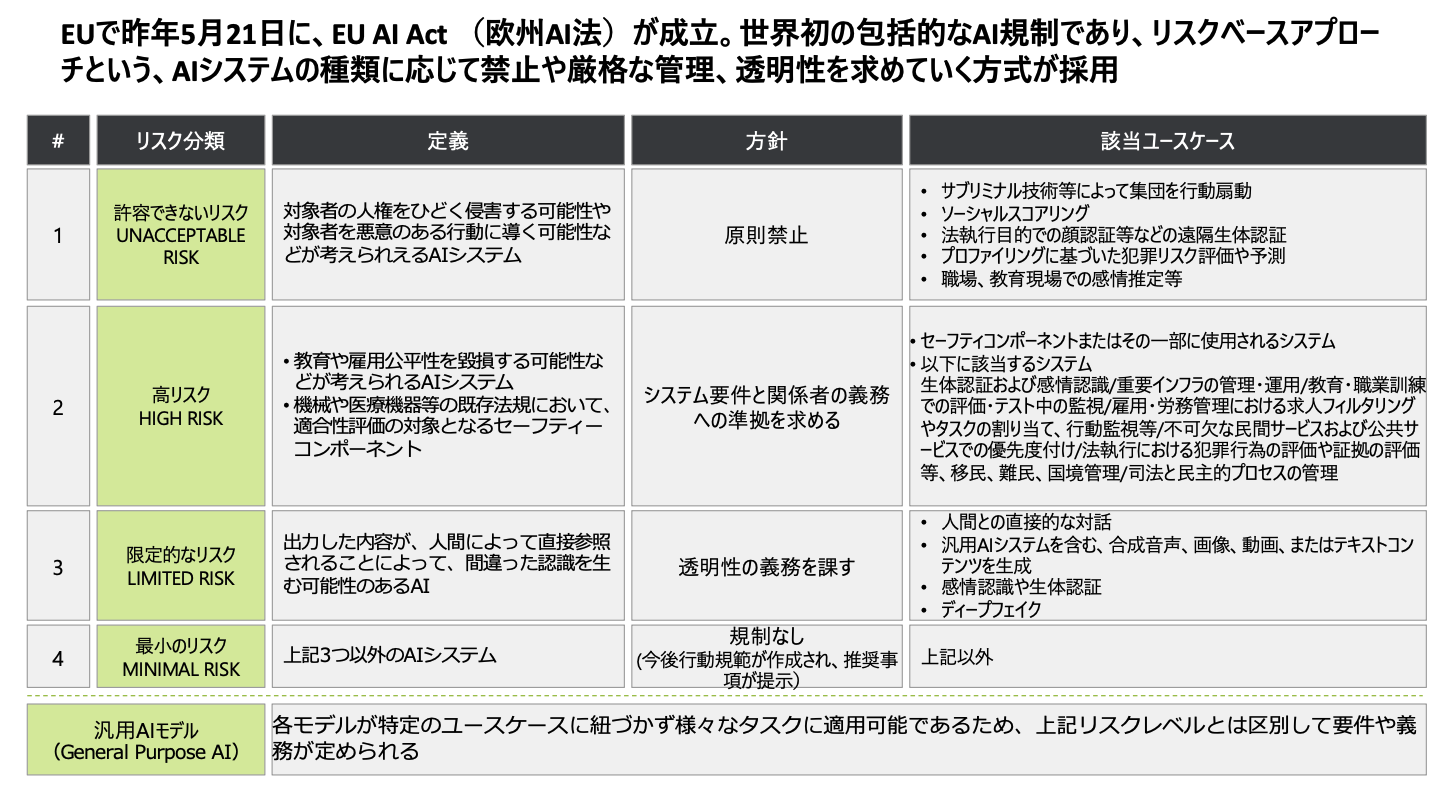

まず一つは、EUに関しては、EU AI Act(AI法案)が成立した。EU AI Actは、生成AIも含め、適用型のシステムを広くAIシステムであると定めて規制対象とした包括的なAIのリスクコントロールを行っている。

EU AI Actではリスクベースアプローチという、AIシステムの種類に応じて禁止や厳格な管理、透明性を求めていく方式が採用されている。

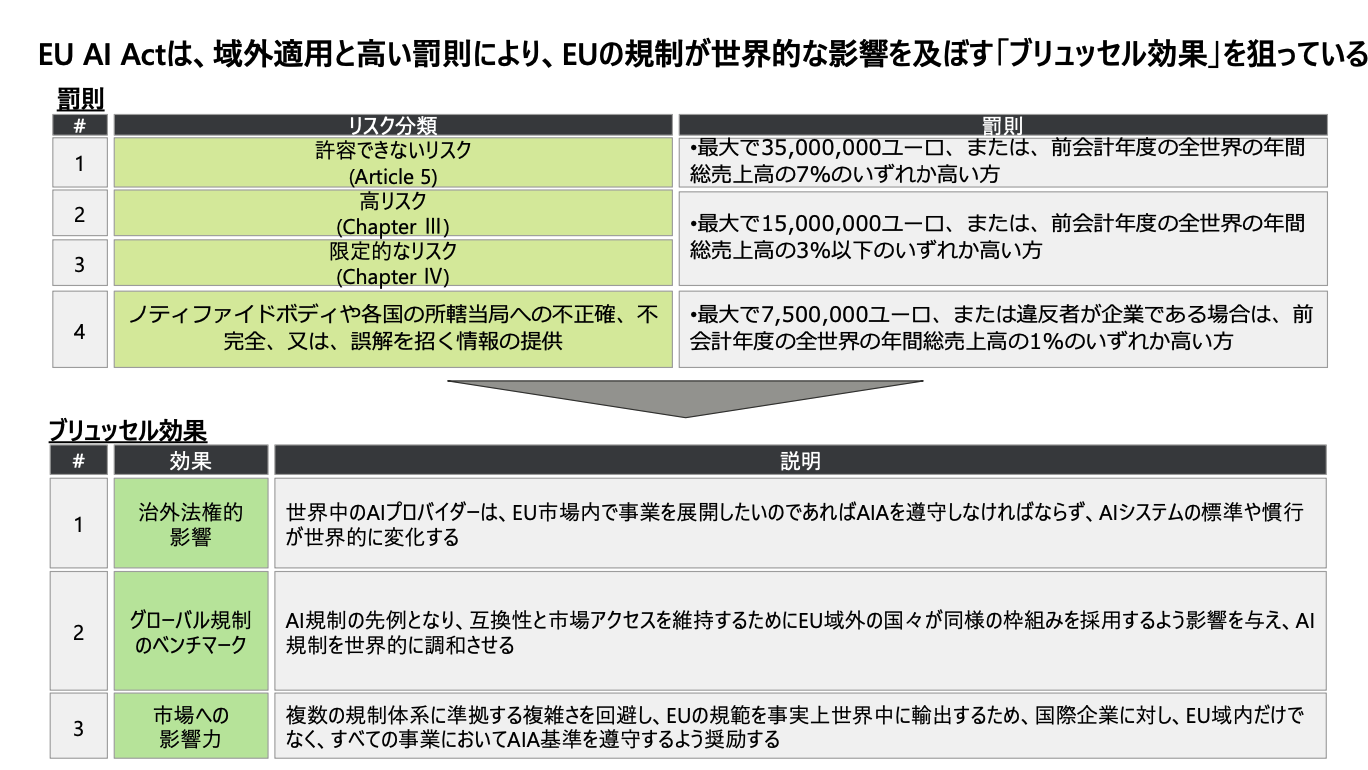

AI利用の禁止事項に関する違反の場合は、最大3,500万ユーロあるいは前年度の全世界総売上高の7%のいずれか高い方を科すという厳しい罰則がある。

例えば、日本ではAIを活用して職場においてその人の健康状態や心理状態をチェックや分析をして、労務管理に役立てるサービスがよく見られる。しかし、これはEU AI法案では最も高いリスクとして禁止事項に分類されると見られる。日本で行われているAIのサービスというのは、実はEUでは禁止されているものが結構ある、という状況である。

EU AI Act のポイントとして、AIの開発企業だけではなく、AIを単に利用者として使用しているだけの企業も対象になっていることがあげられる。

AIを使っているだけの企業が例えば社員のウェルビーイングのための心理状態のチェックにAIを使っていて、実はその社員の中にEUに住んでいる人がいて、EUの支部があったら違反して高額の罰金が適用されるということになる恐れもある。

このようにEU AI Actは包括的かつ厳格な規制であり、各国におけるAIのリスクコントロールのベーススタンダードになっていくだろうということが去年は普通に言われていた。

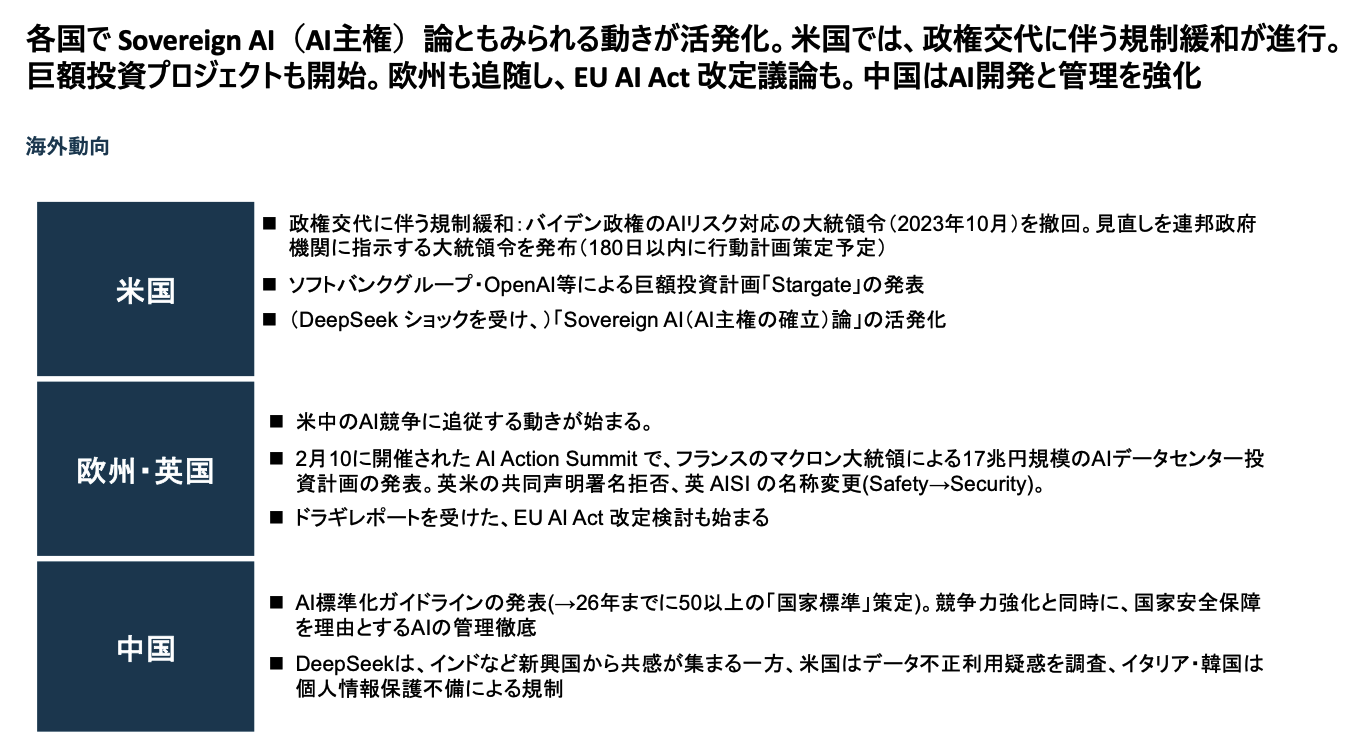

しかし、この流れは2025年に入り大きく変わりつつある。米国では、トランプ政権成立に伴う、AI規制の緩和(AI開発の加速)が進行している。バイデン政権のAIリスク対応の大統領令(2023年10月)を撤回し、見直しを連邦政府機関に指示する大統領令を発布した。また、ソフトバンクグループのOpenAI等による巨額投資計画「Stargate」の発表なども相次いでいる。

欧州・英国も米中のAI競争に追従する動きが始まっている。2月10日に開催された AI Action Summit で、フランスのマクロン大統領は17兆円規模のAIデータセンター投資計画を発表した。また、ヨーロッパ中央銀行の総裁やイタリアの首相を務めたマリオ・ドラギ氏監修の、 EUの競争力強化に関する、いわゆる「ドラギレポート」を受けた、EU AI Act 改定検討も始まっている。

これは、環境規制もそうであるが、データ規制、AIの規制がEUの経済成長の足かせになったという指摘がされたためである。

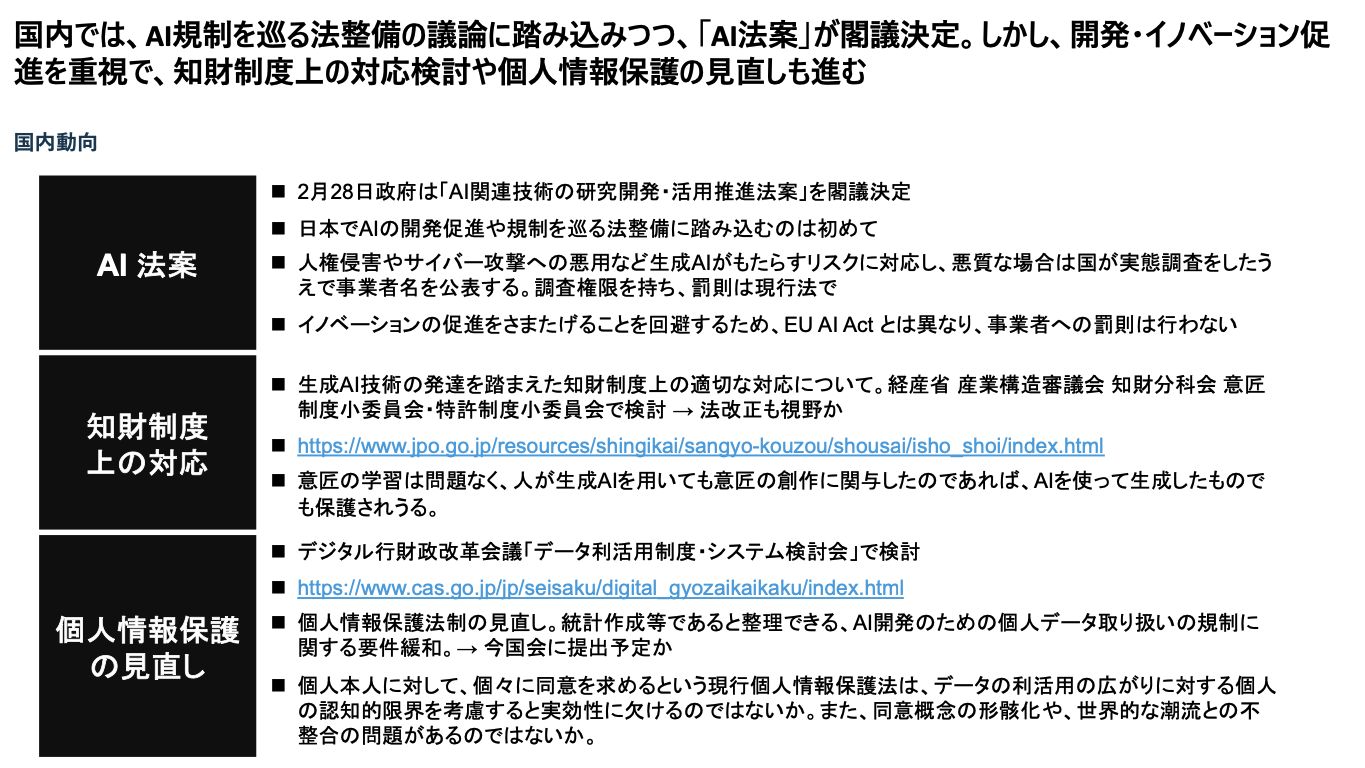

国内の話も少し述べておく。日本では2月28日に政府が「AI関連技術の研究開発・活用推進法案」を閣議決定、5月28日に参院本会議で可決、成立した。これはリスクのコントロールと・規制に踏み込んだ、初の法案であるが、名称にあるとおり同時にAIの研究開発・活用を推進する内容になっている。

規制を意識しつつも、政府においては経産省を中心としてAIはどんどん使っていくべきであるという考え方に基本的に今は立っている。

日本はAIをイノベーションの起爆剤として捉えている。

また、別の流れではあるが、関連する規制として、個人情報保護の見直しについても、より実務に適した王構成や、個人情報保護・規制の国際的なトレンドとの整合性を踏まえて、議論が進んでいる。

こうした動向を踏まえて、企業はAIガバナンスをどのように構築していけばよいのであろうか。

博報堂DYグループでは、「人間中心のAI」という理念のもと、グループ全体でのAIガバナンス体制を構築している。

HCAIが提唱する「人間中心のAI」という考え方

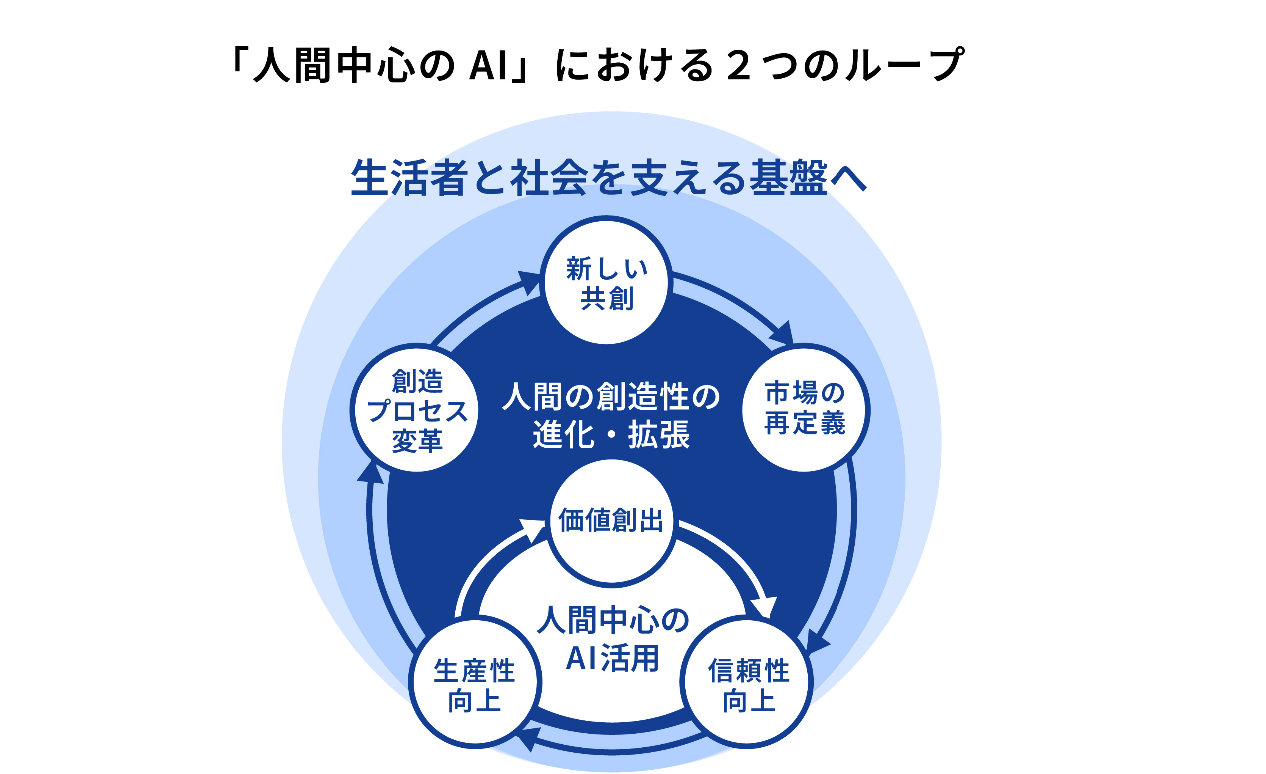

AIが人の役に立つことは、原点として非常に重要である。しかし、それだけでなく、AIが人の創造性を高める、生活者の発想に基づいて、AIというのが社会的な価値を持つために使われるべきだという点に立脚して、Human-Centered AI Instituteという組織を立ち上げた。

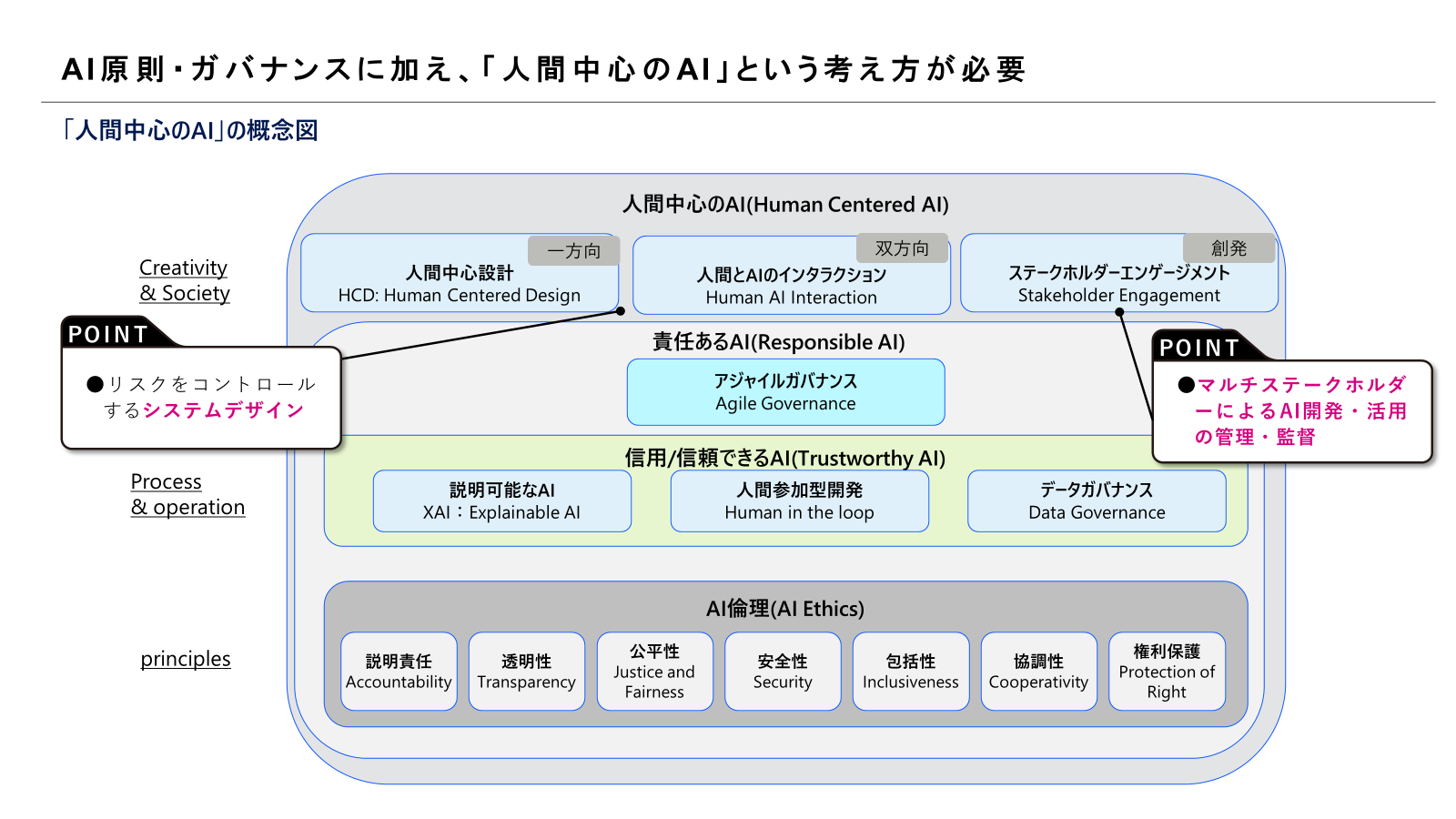

AIに関してはこれまで「AI倫理」や「信頼できるAI」「責任あるAI」という考え方が重視されてきた。例えば、「AI倫理」においては、AIは説明責任がちゃんと果たせるべきであるとか、AIは内部の処理が分かる、判断ロジックが分かるように透明性があるべきだ、AIが使っているデータというのは公平であるべきだ、AIはアウトプットが危険なことにならないように安全性があるべきだという原則を中心として議論がされてきている。

しかし私たちは、AIを真に生活者、社会に資するように活用していくためには、AI原則の遵守、その上に構築された信頼できるAIや責任あるAIという実装や運用の手法にに加え、「人間中心のAI」というコンセプトもあわせ持って、設計・開発・活用・管理を行っていく必要があると考えている。

人間中心のAIは、人間中心の設計(Human Centered Design)がその源流となっている。これに基づくと、例えば人間のニーズを満たし、人間がよりやりたいことを実現でき、また人間のミスを防止し、適切な意思決定を行うにはどうしたらよいのかを考慮した設計を行うことになる。さらには、AIのハルシネーションを拡大させない、AIのバイアスを助長させないような設計やインタラクションがどうあるべきか、といったことも考える必要があるだろう。加えて、マルチステークホルダー・エンゲージメントという概念を取り入れ、広く生活者の参画を促していくことも重要なる。

ここでスマートシティを例にあげてイメージしてみると分かりやすい。スマートシティにおいては、AIを適用して交通量の最適化を行ったり、電力・ガスといったエネルギー消費の最適化を行ったり、あるいはカメラによる画像認識や人流の行動予測を用いて犯罪の防止を図るといった機能が組み込まれる。この際、従来のAIの開発者や利用者という視点でのガバナンスにおいては、AIを活用している企業や自治体がステークホルダーと位置付けられてきた。しかし、実際にそのAIによる結果のインパクトを直接受けているのは、そこで暮らしている市民である。生活者こそが今やAIの影響を最も強く受ける真のステークホルダーとも言える。

したがって、生活者を広く参画させたマルチステークホルダーのエンゲージメントをどのように実現していくかによって、人間中心のAIというコンセプトに基づくガバナンスが構築されていくことになる。

人間中心のAIとしてアップデートされ続けるAI観

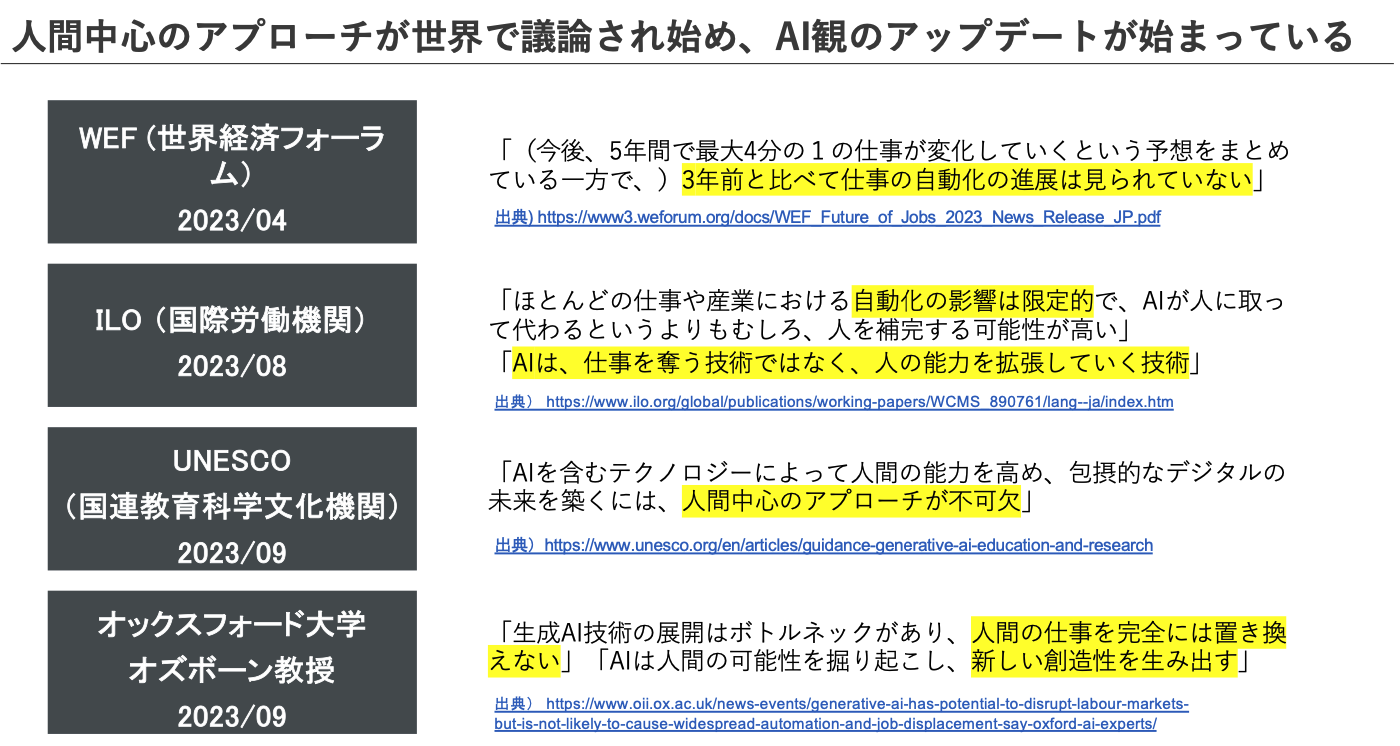

人間中心のアプローチは世界でも議論が続いており、近年はAI観のアップデートも始まっている。世界経済フォーラム(WEF)は「今後、5年間で最大4分の1の仕事が変化していくという予測をまとめている一方で、3年前と比べて仕事の自動化の進展は見られていない」と報告している。

国際労働機関(ILO)も「ほとんどの仕事や産業における自動化の影響は限定的で、AIが人に取って代わるというよりもむしろ、人を補完する可能性が高い」などと述べている。

ここで問題視されている現象に関しては、一部で、ノーベル経済学賞を受賞したロバート・ソロー氏が1987年に指摘した「生産性のパラドックス(ソロー・パラドックス)」との類似も議論されているが、今起きているAIの高度化や性能上昇が、単純に人間の仕事を奪うことに結びつくだけではない可能性を示している。むしろ、一面において人間の能力を拡張していくところがあり、そこにこそフォーカスすべきだという考え方が世界的にも広がってきている点は注目すべきであろう。

博報堂DYグループは、「人間中心のAI」という理念のもと、AIのリスクを適切に管理しながら、人間の創造性を高め、社会に新たな価値を提供していきたいと考えている。テクノロジーとクリエイティビティの両面から、AIの新しい可能性を追求し続ける。

-

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表1998年、慶應義塾大学経済学部卒業。外資系コンサルティング会社、グローバルインターネット企業を経て、監査法人グループにてAIおよび先端技術を活用した企業支援、産業支援に従事。

東北大学 特任教授、内閣府AI戦略専門調査会委員、日本ディープラーニング協会 顧問。

著訳書に、『ウェブ大変化 パワーシフトの始まり』(近代セールス社)、『グローバルAI活用企業動向調査 第5版』(共訳、デロイト トーマツ社)、『信頼できるAIへのアプローチ』(監訳、共立出版)など多数。