博報堂DYグループにおけるAIガバナンスの取り組み

AIの進化と規制の変化が加速する中、企業にはリスクを管理し、従業員が安心して活用できる仕組みづくりが不可欠である。

今回は、その実践例として、2025年6月に博報堂DYホールディングスのHuman-Centered AI Institute(以下、HCAI)の所長補佐、西村 啓太が東京広告協会の法制委員会勉強会で「博報堂DYグループにおけるAIガバナンスの取り組み」をテーマに行った講演内容をレポート形式で紹介する。

AI活用の指針となる「AIポリシー」

AIの活用により社会や産業全体の発展が見込める一方で、AIの適正利用を促すためのガバナンスも必要である。AIの利用により、意図せずとも著作権侵害が発生してしまうリスクもある。また、特に広告業界においては、AIの不適切利用があればクライアントに迷惑をかける結果にもなりかねない。

博報堂DYグループでは「生活者発想」のフィロソフィーを前提に、Human-Centered AI Institute(HCAI Institute)を設立し、「人間中心のAI」を意識した取り組みを進めているが、そのテーマの一つとして「AIガバナンス」の検討も進めている。

当社グループの取り組みのうち、まず紹介するのは、博報堂DYグループにおけるAI活用の指針となる「AIポリシー」である。

当社グループでは、2024年8月にAIポリシーを外部公開した。このようなポリシーを公開するか否かは、企業によりスタンスが異なる。当社グループでは、見えないところでAIを利用するのではなく、AIのリスクと適切なかかわり方についてのスタンスを公明正大に提示することが重要であると考え、AIポリシーを広く公開した。

【参考リリース】博報堂DYグループのAIポリシー策定について

https://www.hakuhodody-holdings.co.jp/news/corporate/2024/08/4948.html

AIポリシーに盛り込む要素については、日本政府のAIガイドラインに加え、世界各国政府のAI規制の動向や、業界、団体、先進事業者のAIポリシーを参照し、俯瞰的に検討を行った。最低限ポリシーに加えるべき要素を整理しつつ、生活者中心の原則、社会への貢献や生活者の可能性追求、知的財産保護など博報堂DYグループとして盛り込みたい要素を加えている。

さらに、AIの可能性を「人間の想いを解き放つもの」と整理し、生活者を中心にAIの技術開発を進めていくことや、生活者と企業社会の可能性を追求する新しい価値を創造するためにAIを活用する点を明記している。

また、知的財産保護については、AIの利用によって著作権や商標権、知的財産権侵害がないように適切な処置を講じ、クライアントやクリエイターの権利を尊重することを表明している。

このポリシーが、後述する当社グループのガイドラインや相談窓口、画像類似チェッカーツールの活用といった取り組みにつながっている。

実務上のルールを定める「生成AIガイドライン」

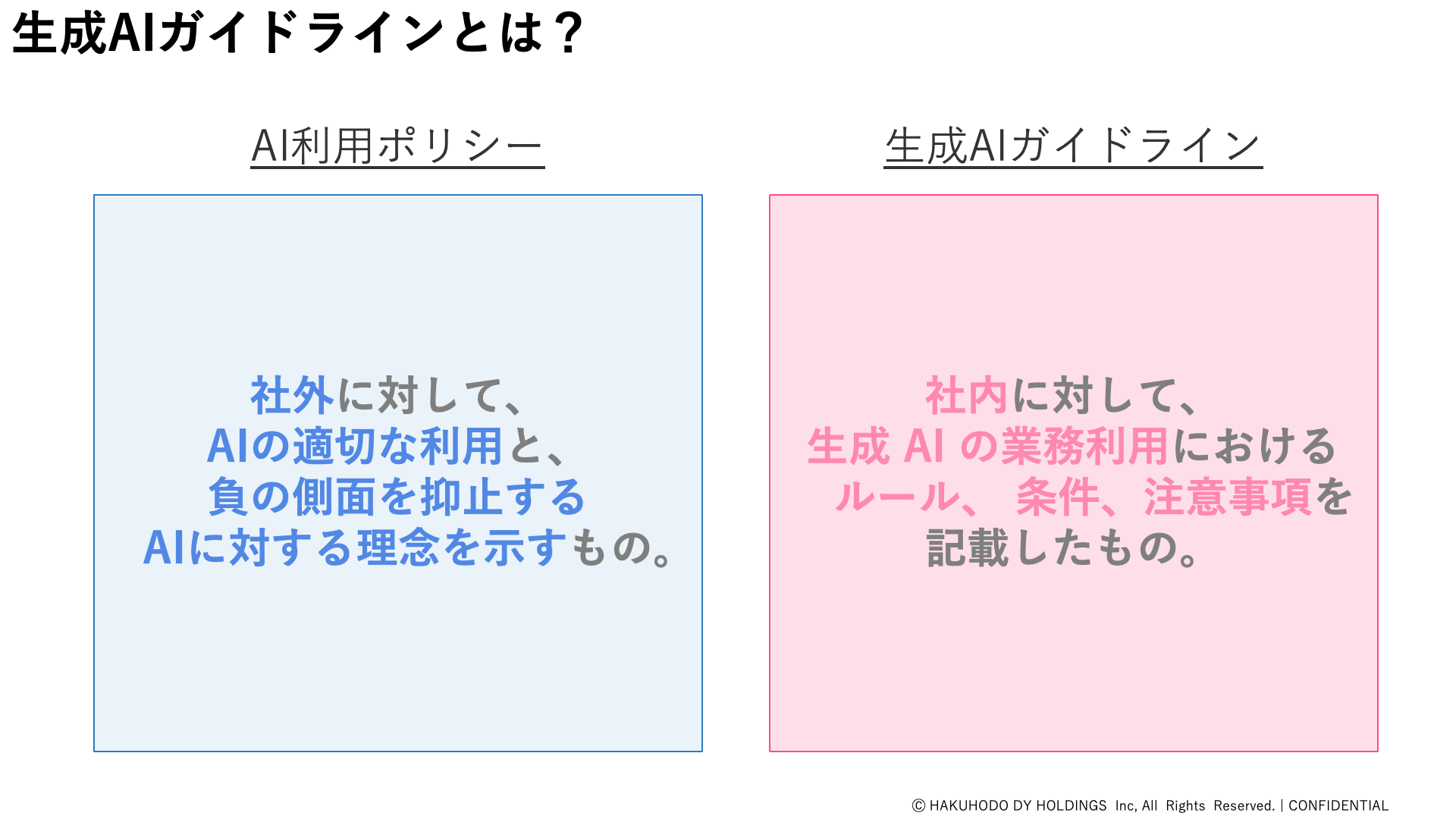

より具体的に業務でどのようにガバナンスを機能させるかについて、当社グループではガイドラインにより生成AIの業務利用におけるルールや条件を整理している。

AIポリシーが社外に対して理念を示すものであるのに対し、生成AIガイドラインはAIの業務利用における具体的なルールを定めたものである。

従業員のAIリテラシーは様々である。AIに詳しい人もいれば、あまり利用したことが無い人もいる。よってガイドラインでは、ファクトチェックの必要性や法的リスク、レピュテーションリスク、社外ツール利用における利用規約の確認、商用利用の可否チェックなど、基本的なことから網羅的な記載を行っている。

特に広告業界においては、制作会社など委託先の管理も重要である。クライアントから委託を受けている以上、再委託先の管理にも責任がある。委託先からの納品物についてもファクトチェック、類似性チェックを行い、また業務委託契約をする際にも生成AIの利用について記載することをガイドラインに明記している。

グループ横断窓口による一貫した対応

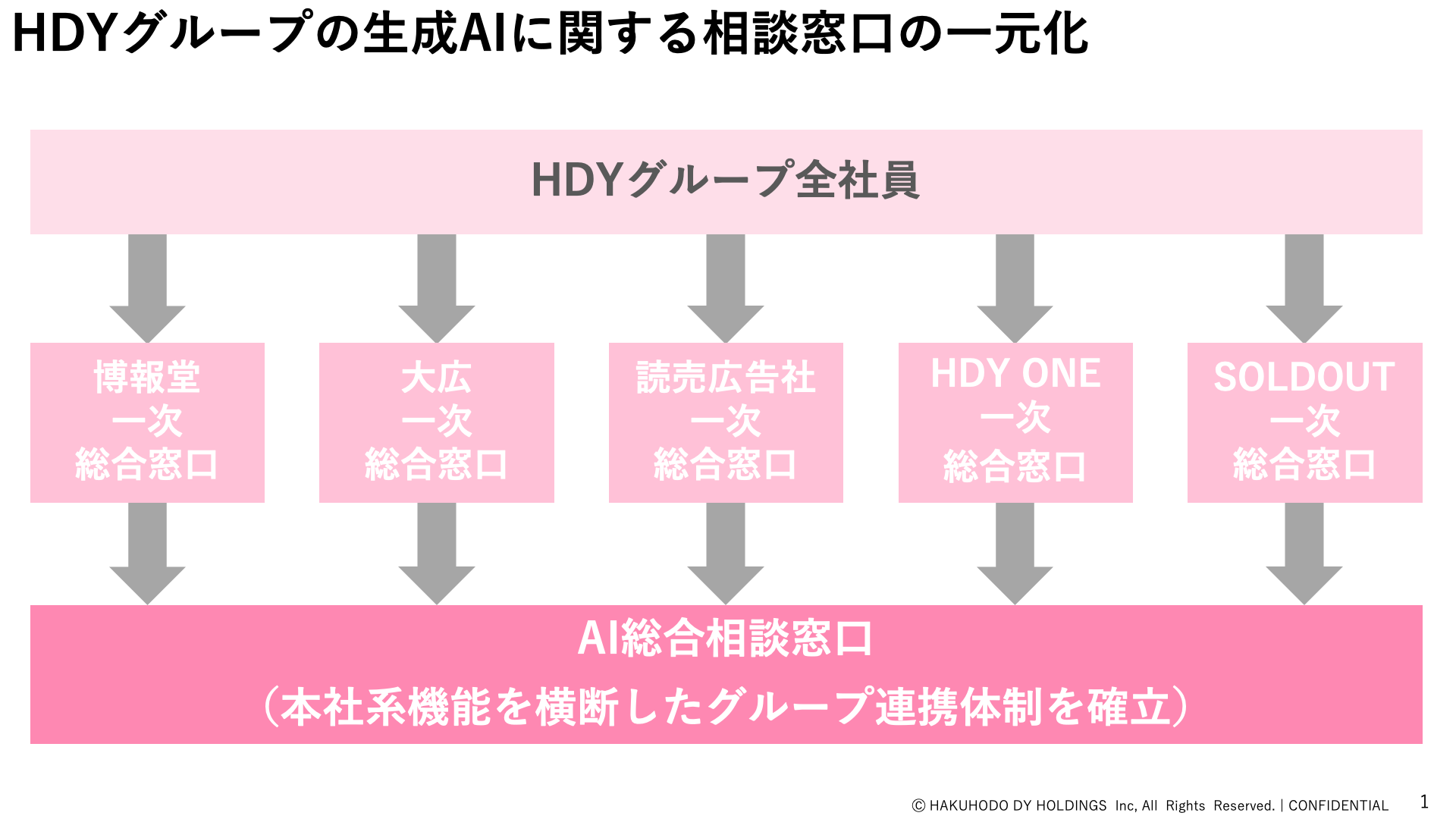

また、懸念されるのが社員が会社の規程や承認フローを十分に確認せず、生成AIを業務で利用してしまうケースである。そこで当社グループでは、グループ横断でAIに関する問い合わせ窓口を一本化し、どのグループ企業からでも問い合わせを受けられる体制を整備している。

当社グループの特徴として、グループ会社同士で業務上の競合が発生してしまうケースもある。よって、各社の一次窓口にて受け付けたのち、クライアント情報などを削除したうえでグループ全体の窓口に問い合わせが来るようにしている。

この窓口は法務・総務・情シス・広報・リスクコンサルティングなど全社の関係者で協議を行い、CAIO(Chief AI Officer)の森が確認して最終的な回答を行うプロセスとしている。

回答にはかなりの負荷がかかり、もちろんFAQを作成して類似の質問はすぐに解決できるようにしているものの、簡単に回答できない問い合わせが毎日2、3件発生している状況である。

画像類似度チェッカーによる自己解決の支援

多くの問い合わせを迅速に回答するためには、ある程度従業員が自己解決できる仕組みも必要である。特に当社グループにおいては、生成AIが生成したコンテンツについてチェックできる仕組みの構築が重要であると考えている。

生成AIのリスクには「無限定性」という特徴があると言われている。従来、新しい技術を利用するのはエンジニアや情報システム部門が主であったが、生成AIは誰でも利用できる。また、生成AIは画像生成もできればテキストの生成もでき、用途も無限定である。この二つの無限定性により、「誰しも、誰かの著作権を侵害し得る」という状況が生まれやすいのである。

経済産業省による「コンテンツ制作のための生成AI利活用ガイドブック」では、ゲームやアニメなどコンテンツ業界と並列で、広告業も名指しで活用シーンや留意点が示されている。本ガイドブックの中に「他人の著作物と類似性の確認」という項目があり、そこには「必須」のマークが付けられている。

コンテンツ制作のための生成AI利活用ガイドブック

https://www.meti.go.jp/policy/mono_info_service/contents/ai_guidebook_set.pdf

これまで各省庁が公表しているガイドラインでは「必須」という記載はあまり見られなかった。このガイドブックの記載により、類似性のチェックに対する重要性が、また一つ違う段階になったと認識している。

このような背景もあり、当社グループではセキュリティやAIガバナンスに精通しているAcompany社と協業し、画像の類似度チェッカーツールを開発した。

このツールでは、画像を入力すると、その画像と既存の画像との類似度を計算できる。リスクが高い順に既存の画像を並び替え、特にリスクが高いものに印をつける。

画像の類似度は、画像がどのような場所にあり、どのようなものが描かれているのかといった「意味」と、どのような構図で何がどこに配置されているかといった「構造」の二つの観点で判定している。

また、画像に関連するキーワードを自動で生成でき、例えば画像から「自然光を反射するサイダーグラス」といったキーワードが出力されると、そのキーワードでさらに画像検索を行うこともできる。これにより、新たに発見された画像との類似度を計算することも可能である。

特にクライアントワークでは、競合企業との類似度チェックも重要である。よって本ツールでは、競合の社名やブランド名を追加し、リスクをチェックすることもできる。

このようなツールの活用により、従来広告業界において制作物に対するオリジナリティチェックを行ってきたのと同様に、各部門の担当者でAIのリスクチェックを行えるようになる。

今回は、AIポリシーによる理念の策定からガイドラインや問い合わせ窓口の設置、ツール活用といった実際の運用まで、AIガバナンスの実例を学んだ。このような取り組みにより、クライアントに対してAIを活用した施策を安心・安全に提案できる。

もちろん、AIガバナンスはAI技術の進化と共に、継続的な見直しが必要となる。新しいツールが登場すれば、新しいリスクも生まれてくるのである。

AIのリスク管理やガバナンスについては、今後も継続的に情報をアップデートし、常に最新化された対策を続けていく必要があるといえる。