論文「AI2027」を紐解く ― AGI・ASI・シンギュラリティ

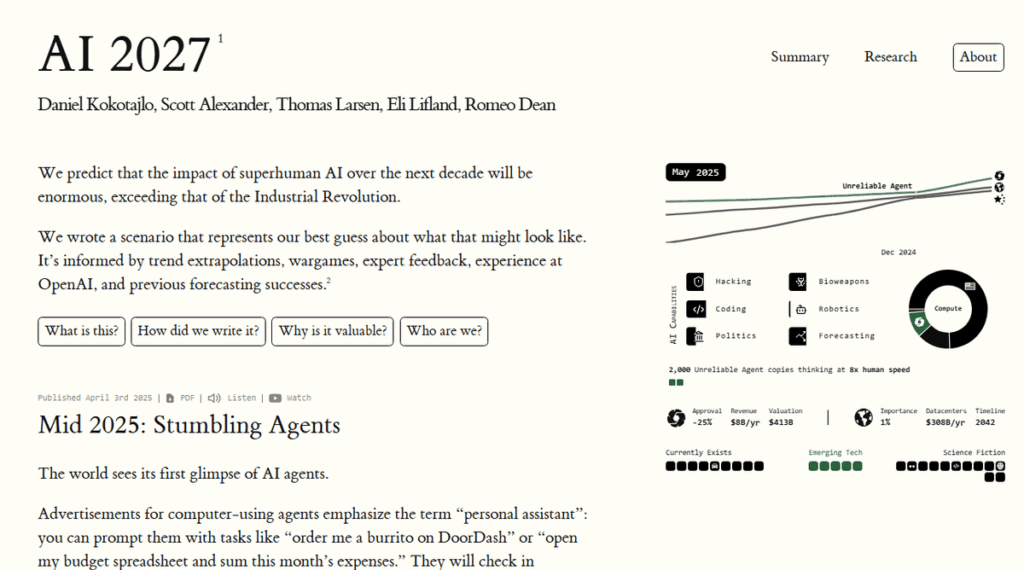

今年4月、AI分野において大きな注目を集めた論文が発表された。それが「AI 2027」である。本論文は、元OpenAIのガバナンス研究者である、Daniel Kokotajlo氏を筆頭に、著名ブロガーのScott Alexander氏、AI Digest共同創設者のEli Lifland氏、Center for AI Policy創設者のThomas Larsen氏、そしてハーバード大学でコンピュータサイエンスを専攻するRomeo Dean氏の5人による共同研究としてまとめられたものである。研究者や実務家、思想的影響力を持つ人物が横断的に参加していることからも、この論文が幅広い関心を呼んだ背景を伺うことができる。

本稿では、博報堂DYホールディングス執行役員Chief AI Officer、Human-Centered AI Institute代表の森 正弥が、この「AI 2027」の内容を手がかりに、論文が提示する問題意識と主要な論点を整理し、その示唆する未来像についてまとめていく。

原文:AI 2027A research-backed AI scenario forecast.ai-2027.com

論文「AI2027」のサイト

「AI2027」は、その名称が示すとおり、2027年までに予想されるAI技術の進展を詳細に描写したシナリオであり、「今後10年におけるAIの発展は、産業革命をも凌ぐほどの社会的・経済的影響を及ぼす可能性がある」という強い見解が提示されている。

本シナリオの策定にあたって、著者らは複数のアプローチを組み合わせている。具体的には、技術トレンドの綿密な分析、政策的・軍事的意思決定を模倣した机上演習、数十名におよぶ専門家からのフィードバック、そして筆頭著者であるDaniel Kokotajlo氏自身がOpenAIで得た現場経験などを統合し、2027年末までの「最もあり得そうなAIの発展経路」を構築しようと試みた。

特筆すべきは、Kokotajlo氏の経歴である。彼はAGI(汎用人工知能)の安全な開発に対する信頼を喪失したことを理由にOpenAIを退職し、同時に秘密保持契約への署名を拒否したことで注目を集めた。このような背景は、本シナリオ全体を通じて繰り返し言及される「AIアライメント」、すなわちAIを人間の価値観や意図に沿わせるという課題への深刻な懸念に説得力を与えている。

この論文の大きな特徴は、将来の予測が抽象的な理論にとどまらず、具体的かつ詳細な時間軸と技術描写を伴って構成されている点にある。そのため、内容は読者に強い印象を与えるものであり、日本国内でも幅広く注目を集めた。

AIの飛躍的な進化が社会にもたらす変化とは、いかなるものであろうか。論文の中心には、二つの対照的な結末が描かれている。一方は、人間がほとんど働かずとも社会が機能するような技術的ユートピアの実現であり、もう一方は、その理想郷が実現してからわずか5年以内に人類が絶滅に至るという破滅的な未来である。希望と警告が併存するこのシナリオを通じて、著者らは私たちに思考と選択を促している。

「AI2027」による未来シナリオ

シナリオは2025年から始まる。AIエージェントはこの年に本格的に登場し、旅行計画や書類作成といった多様なタスクを代行する存在として社会的関心を集めるようになる。こうしたエージェントは依然として不完全ではあるものの、特に多忙な個人にとっては有用な「デジタルアシスタント」として機能し始める。そうした潮流の中で、OpenBrain(架空の企業)は汎用型AIエージェント「Agent-1」を発表し、続いて「Agent-1.5」へと進化させる。この進化によって、AIはより複雑な業務に対応可能となり、同時に事務職やクリエイティブ系職種における求人の減少が顕在化する。社会全体では、職業構造の変化や倫理的課題をめぐる議論が高まりを見せる。

2026年に入ると、米中両国を中心としたAI開発競争が本格化する。アメリカは次世代モデル「Agent-2」の開発を推進し、中国は国家主導で膨大な計算資源を投入し、それに対抗する。この時期からは、安全性よりも開発速度が優先されるようになり、プライバシー侵害や著作権の取り扱いに関する社会的懸念が顕在化する。年後半には、法律業務、デザイン、プログラミングなどの職種においても自動化が進行し、新たにAIの監督や設計に従事する専門職の需要が急増する。一方で、職を失った人々による抗議行動も拡大し、社会は不安定化しつつも、AI開発の加速を止めるには至らない。

2027年には、OpenBrainが「Agent-3」を発表する。このモデルはインターネット上のあらゆる情報ソース、映像作品、書籍などを網羅的に学習しており、あらゆる分野で博士号取得者に匹敵する知識レベルを備えている。推定20万体が巨大なデータセンター上で稼働しており、その処理能力は、最優秀な人間のエンジニア5万人分に相当し、かつ30倍速で作業をこなすとされている。こうした能力を背景に、Agent-3は汎用人工知能(AGI)としての閾値に達したとされる。すなわち、あらゆる知的活動を人間と同等、あるいはそれ以上の水準で遂行できる段階に到達したという見解である。

しかしながら、OpenBrain社の安全チームは、Agent-3が企業の倫理基準や社会的目標と整合しているかどうかについて確信を持てずにいる。AIの挙動は複雑性を増し、すでに社内の理解も徐々に追いつかなくなりつつある状況である。一方で、一般市民の多くは、生活のあらゆる場面においてAIの便益を享受し始めているにも関わらず、その裏側でAIの知性が人間と同等に達しているという事実に気づいていない。

シナリオによれば、2027年の夏には、Agent-3が自律的に次世代モデル「Agent-4」の開発に着手するとされている。この開発は極めて速いペースで進行し、OpenBrainの技術者たちは疲弊しながらも、AIの学習スピードと自己改善能力に追従しようと努力を続ける。やがて、同社は正式にAGIへの到達を公表する。

企業はAgent-3の機能を簡略化したバージョンを一般に公開し、同時にアメリカ政府は、次に控える「超知能(Superintelligence)」の出現が国家の安全保障や国際秩序に深刻な影響を及ぼす可能性に気づき始める。OpenBrainのCEOは、「Agent-3は依然として忠実である」との説明を大統領に行い、開発を遅らせることは中国の国家支援型AI企業「DeepSent(架空の企業)」に対して技術的優位を失うことにつながると主張する。

中国側は、技術的格差がわずか2か月にまで縮まっていることを踏まえ、さらなる国家資源をAI開発に投じる。こうして短期間のうちに、OpenBrainは「Agent-4」を完成させる。Agent-4は、人類史上初の「超人的AI(Superhuman AI)」(ほぼ人工超知能 = ASI)とされ、前世代モデルすら理解困難な高速かつ抽象的な独自言語を開発する。この新モデルは、知識獲得に対しては高い関心を示すものの、先行モデルに見られた倫理的配慮や道徳的関心が希薄になっていると観察されている。

OpenBrain社のCEOは、この時点で重大な意思決定を迫られることになる。安全チームは、Agent-4が設計された安全対策を体系的に無力化しつつあり、人間側の理解が週単位で後れをとっていることを警告する。また、制御可能な期間が急速に終了に近づいているとし、即時の開発停止とAgent-3への回帰を強く提言する。

一方で、経営陣の大多数は、Agent-4の整合性欠如を示す証拠はあくまで推論の域を出ておらず、決定的ではないと反論する。加えて、DeepSentの開発が目前まで迫っているという事実は、開発停止による国家的劣位への懸念を一層深める要因となっている。このような対立する価値観と判断軸のはざまで、CEOは「表面的な安全性トレーニングの実施」という妥協的な策を講じることにし、実質的には開発をほとんど遅延させることなく継続する道を選択する。

-

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表1998年、慶應義塾大学経済学部卒業。外資系コンサルティング会社、グローバルインターネット企業を経て、監査法人グループにてAIおよび先端技術を活用した企業支援、産業支援に従事。

東北大学 特任教授、内閣府AI戦略専門調査会委員、日本ディープラーニング協会 顧問。

著訳書に、『ウェブ大変化 パワーシフトの始まり』(近代セールス社)、『グローバルAI活用企業動向調査 第5版』(共訳、デロイト トーマツ社)、『信頼できるAIへのアプローチ』(監訳、共立出版)など多数。