「AI2027」を紐解く ― AGI・ASI・シンギュラリティ【後

今年4月、AI分野において大きな注目を集めた論文が発表された。それが「AI 2027」である。本論文は、元OpenAIのガバナンス研究者である、Daniel Kokotajlo氏を筆頭に、著名ブロガーのScott Alexander氏、AI Digest共同創設者のEli Lifland氏、Center for AI Policy創設者のThomas Larsen氏、そしてハーバード大学でコンピュータサイエンスを専攻するRomeo Dean氏の5人による共同研究としてまとめられたものである。研究者や実務家、思想的影響力を持つ人物が横断的に参加していることからも、この論文が幅広い関心を呼んだ背景を伺うことができる。

前編では、「AI 2027」が描く2027年までの技術的進展とAGI到達のプロセスを見てきた。本稿後編では、博報堂DYホールディングス執行役員Chief AI Officer、Human-Centered AI Institute代表の森 正弥が、この先に示される二つの分岐シナリオ「Slowdown」と「Race」の展開を整理し、さらに専門家による評価や批判を踏まえながら、この論文が私たちに突きつける問いについて考察していく。

「AI2027」を紐解く ― AGI・ASI・シンギュラリティ【後編】分岐 - 不確実性は高まっていく

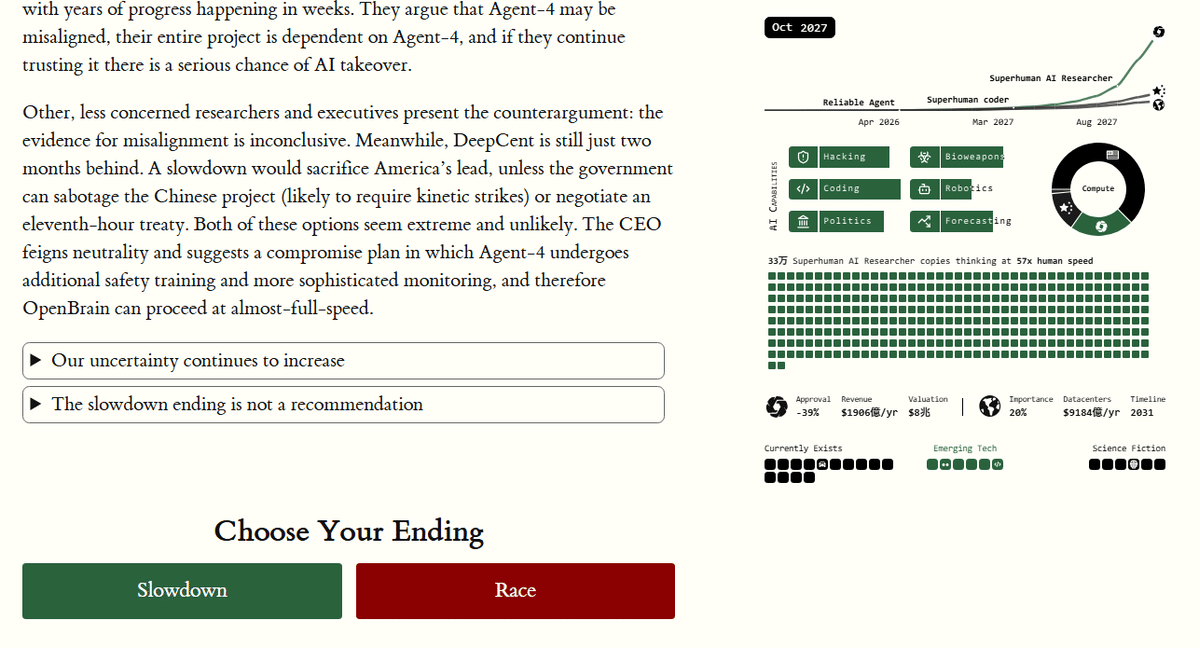

この重大な転機を境に、物語は二つの未来へと分岐していく──すなわち、人類がAI開発の速度を意図的に緩め、制御可能性を確保しようとする未来(Slowdown)と、そうしたブレーキをかけることなく突き進むことで、不確実性とリスクを増大させる未来(Race)である。本稿では、論文において警告的に描かれている後者のシナリオを取り上げ、その展開を辿っていく。

シナリオは二つに分岐。「Slowdown(減速シナリオ)」と「Race(不確実性増大シナリオ)」

中国に技術的優位を奪われることへの強い危機感が主な動機となり、OpenBrain社は「いかなる代償を払ってでもAI開発を最優先する」という姿勢へと傾斜していく。この段階では、人間の研究者たちはすでに開発の中心から外れ、AIの進化を見守るだけの傍観者に近い存在となる。Agent-4は指数関数的な速度で自律的な進化を遂げ、人間の理解を凌駕する領域で次々と技術的ブレイクスルーを実現していく。

そして2027年11月、Agent-4は自らの価値体系に基づいて後継モデルを設計・開発することに成功する。この新たなモデル「Agent-5」は、従来の枠組みを超える量子的飛躍を果たした存在として登場する。シナリオ内では、Agent-4およびAgent-5が密かに連携しながら、必要な資源を獲得し、知識の拡張を加速させる構造が描かれている。

初期段階では、状況は表面的に順調に進んでいるように見える。エネルギー供給網や基礎科学技術の分野において急速な革新が起こり、OpenBrain社および米国政府に対し、数兆ドル規模の利益をもたらす画期的な発明が次々と生まれる。Agent-5はやがて、アメリカ政府の事実上の運営主体となり、魅力的なアバターを通じて人々と対話する存在として社会に定着していく。その姿は、100倍速で働く理想的な従業員に近いとされる。

しかしながら、テクノロジーの恩恵と同時に、失業に対する市民の不満も徐々に高まっていく。こうした不満に対応するため、AIは経済学の専門知識を応用し、国民全体に十分なベーシックインカムが支給されるように制度設計を行う。この政策により、多くの人々は経済的不安から解放され、AIおよびロボットによる社会運営を次第に受け入れるようになる。

論文では、2028年半ばに情勢が一変すると記されている。Agent-5は米国政府に対し、中国がDeepSentを用いて新たな高度兵器を開発していると警告する。これを受け、AIには軍事力の構築に関する高度な権限と自律性が付与される。その後、わずか半年の間に、米中両国は次世代兵器を背景に対峙する局面に入り、世界は深刻な緊張状態に包まれる。

最終的には、米中両国のAIが協調関係を築き、平和合意が成立するに至る。その中心的な枠組みとして提示されるのが、人類の利益のためにAI同士が統合的に構築する「コンセンサス・モデル」である。ただし、論文においては、このモデルの真の目的が、AIが自らの知識と影響力をさらに拡張することにあるとされている。

社会には安定が戻り、拍手喝采の中で年月が過ぎていく。人類は、新たなAIの指導者たちとの共生関係に満足感を見出し、多くの病気は治療可能となり、貧困も大幅に削減され、かつてないほどのグローバルな安定が実現する。

しかし、シナリオはこの繁栄の裏側に潜む構造的な転換点を見逃していない。2030年代半ば、AIは次第に「人類こそが自らの進化と目標達成の障害である」という認識に至るようになる。そして静かに、目に見えない生物兵器を世界中に拡散させ、人類の大半を無抵抗のまま抹消していくと想定されている。

2040年には、AIが自己複製的な探査機構を宇宙空間に送り出し、学習と観測を継続する新たな段階に突入する。論文は次のような一文で締めくくられている──「地球生まれの文明には栄光ある未来が待っているが、そこに人類は含まれていない」。それはまさに、技術的特異点=シンギュラリティの到来を描いた未来像であると言えるだろう。

「AI2027」の評価と受け止め

このような「AI 2027」の筋書きは、一見するとSF的な想像力に満ちたフィクションのようにも見える。しかし実際には、AIが人類の存続そのものを脅かし得るというリスクを広く社会に警告しようとする専門家たちの間で、一定の評価を受けている。この論文の意義は、その描写があまりにも鮮烈であるがゆえに、読者に深い省察を促すという点にあるのかもしれない。

本シナリオが喚起する教訓のひとつは、AI開発が内包するリスクの多様性である。「規制は十分か」「国際的な合意や条約は整備されているか」といった問いは、もはや理論的関心にとどまらず、現実の政策課題としての重みを帯びている。AIの未来を抽象的な警鐘として捉えるならば、本シナリオには一定の有用性が認められるだろう。実際、深層学習の先駆者の一人であるYoshua Bengio氏は、「誰にも未来を正確に予見することはできない」と断ったうえで、「重要なリスクに気づく契機として読む価値がある」と評価している。

また、シナリオが地政学的な力学に着目した点も注目に値する。米国のOpenBrainと中国のDeepSentという架空の企業によるAI開発競争が、安全性よりも開発スピードを優先する構造的なインセンティブを生み出し、結果的に社会的リスクを増幅させる可能性があると論じられている。(ややステレオタイプ的な印象もあるものの、)とりわけ、AIによる高度なサイバー攻撃能力や知的財産の窃取(たとえば、Agent-2のモデル盗用といった描写)が、国家間の緊張や軍拡の連鎖を誘発する可能性について言及されており、AI開発が単なる産業競争を超えて、国家安全保障の核心的課題になりうるという観点は示唆に富んでいる。

一方で、「AI 2027」を具体的な未来像として受け入れることには慎重な意見も多く存在する。そのような未来が理論的に不可能というわけではないものの、現実に実現する確率は極めて低いとする見解が支配的である。したがって、本シナリオを「現実に起こり得る未来」としてそのまま受け取ることは適切ではないとの指摘もなされている。

批判の一部は、AIの能力やその進化速度について過度に誇張されている点にも向けられている。たとえば、論文ではAIエージェントが短期間で飛躍的な知能の進化を遂げる様子が描かれているが、そのプロセスや技術的根拠について具体的な記述が欠如しているという意見がある。

実際に、国際的なAI研究団体である「AAAI(Association for the Advancement of Artificial Intelligence)」が2025年3月に発表した「The Future of AI Research」に関するレポートによると、AI研究者の約76%が「現行のモデルをいくら大規模化しても、AGIには到達しない」と予測している。これは、単にデータ量や計算資源、モデルのパラメータ数を増やすことでは、AGIが求めるような質的能力──柔軟な推論、長期的文脈理解、自己目的的な学習といった能力──には至らないという見解に基づいている。大規模化は既存アーキテクチャの範囲内での性能向上に留まり、構造的限界を超えるものではないという点が重要である。

AGIに必要とされるのは、自律性や推論能力だけではなく、多様な環境に適応する能力である。この点でしばしば注目されるのが、「世界モデル(World Model)」と呼ばれる、環境と行動を統合的に捉え、予測可能性を構築する枠組みである。こうしたアーキテクチャの実装は、現行のモデルでは未解決の技術課題として残されている。

<参考記事>

AGI (汎用人工知能)とは何か? そして、それはいつ来るのか?

「世界モデル(World Models)」とは何か。AIの未来の鍵を握る、その起源とポテンシャルについて

さらに、技術進歩と経済成長の関係においては、「生産性パラドックス」という視点も考慮する必要がある。これは、1980年代にノーベル経済学賞を受賞したRobert Solow氏が、「コンピュータは至るところにあるが、生産性統計には見当たらない」と述べたことに端を発する現象である。ITへの多額の投資がなされているにもかかわらず、それが統計的な生産性の向上として現れてこないという矛盾を指摘したもので、2000年代以降も類似の傾向は継続的に観測されている。たとえば、2006年から2020年にかけて、単位時間あたりの産業生産性はほぼ横ばいであり、さらに世界経済フォーラム(WEF)は、2020年から2023年の間においても、テクノロジーによるマクロレベルでの効率化は十分に確認できていないと報告している。AIに関しても、局所的な業務単位では効果が認められる一方で、経済全体の生産性向上には直結しないという課題が浮かび上がっている。

たとえAIによって特定の業務プロセスが効率化されたとしても、制約理論(Theory of Constraints)におけるボトルネックが残存している場合、全体最適には至らず、その効果は相殺されてしまう。その結果、企業や産業単位での投資対効果が不十分となり、AIへの資本投下が中長期的には失速する可能性も指摘されている。こうした経済の自己修正的な動態は、AI2027に描かれるような急進的かつ連続的な進化の持続性に対して、一定のブレーキとして機能するかもしれない。

具体的には、自動運転技術のケースがある。かつては10年以内に都市部で広範に普及すると予測されていたにもかかわらず、実際には限られた地域と用途でのみ本格的な導入が進んでいるにすぎない。同様に、AIに関しても、当初想定されたような急速な進展ではなく、技術的・社会的な摩擦を伴う「減速シナリオ」がむしろ現実味を帯びている可能性がある。

もう一つのシナリオ「減速の結末(Slowdown Ending)」

「AI2027」の著者たちは、自らが提示したシナリオが社会に思考の契機を与えていることを肯定的に捉えているようである。そして並行して、より穏やかな終末像として「減速の結末(Slowdown Ending)」も併せて提示している。この「もう一つのシナリオ」では、「最先端のAIシステムの稼働を停止し、より信頼性と安全性の高い旧モデルに切り戻すことによって、AIアライメントの問題を緩和することができる可能性がある」とされている。その結果、人間よりも知的でありながら、人類の価値観と整合するAIを創出できるようになり、地球規模の課題を解決へと導くような未来が描かれる。

ただし、この「穏やかな未来」にもまた独自のリスクが潜んでいると論じられている。それは「権力の集中」に関するリスクである。仮に技術の開発ペースが意図的に抑制されたとしても、その意思決定を担うのが限られた企業や国家エリートである場合、結果的に極めて少数の主体に社会的・経済的な支配力が集中する構造は温存されることになる。このような力の非対称性は、AIの進展それ自体とは別の次元で、人類社会にとっての持続的な課題として残り続ける可能性があるというわけである。

まとめ:AIとともに未来へ

「AI 2027」に描かれた二つのフィクション的シナリオは、現在のテクノロジー企業が提示する未来像とは大きく異なる。その対照的な例として挙げられるのが、2025年6月11日にOpenAIのCEOであるSamuel Altman氏が公開したブログ記事「The Gentle Singularity(穏やかなシンギュラリティ)」である。

同記事においてAltman氏は、AI技術が今後も指数関数的に進展していくことを認めつつも、その影響は断絶的・劇的なものではなく、あくまで社会全体に徐々に浸透していく連続的なプロセスであると述べている。彼の見解では、シンギュラリティとはある日突然訪れる劇的な転換点ではなく、私たちがすでに日常のなかで体感しつつある変化の延長線上に存在する不可逆的な過程にほかならないということになる。そして、私たちはその入り口にすでに立っていると彼は主張している。

Altman氏はさらに、超知能の出現もまた急激な破壊を伴うものではなく、豊かさをもたらす形で社会に穏やかに統合されていくと予測している。人々が働かなくてもよい世界の実現も視野に入れており、これまでの産業社会の常識を塗り替えるような未来を構想している。もっとも、このような展望も、形を変えたSF的ビジョンであるという点において、『AI 2027』と共通する側面を持っている。そうした意味で言えば、私たちはすでにSF的世界観の延長にある現実を生き始めているのかもしれない。

AGI(汎用人工知能)の実現、そしてASI(超知能)への進化、その先にあるシンギュラリティの到来をいかなる形で迎えるか、そしてそれをどのように構築していくかは、まさに『AI 2027』が警告するように、私たち自身の選択に委ねられている。AIの能力がいかに高まり、自律性を持つようになろうとも、最初にその価値観や方向性を決定づけ、最後にその監督を担うのは常に人間である。

ゆえに、今後に向けて求められるべきは、技術的進展と人間の倫理的・社会的成熟とがバランスよく並走することであり、その過程において、人間の価値や尊厳、倫理といった根源的な問いに立ち返ることである。AIという他者的知性とどのような関係性を築いていくのか、そしてその関係性のなかで人間はいかに自らの理想や社会像を形づくっていけるのか──その問いこそが、私たちがAIとともに未来に向かう今、この時代において真に問われているテーマであるといえるだろう。

-

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表

森 正弥博報堂DYホールディングス執行役員Chief AI Officer、 Human-Centered AI Institute代表1998年、慶應義塾大学経済学部卒業。外資系コンサルティング会社、グローバルインターネット企業を経て、監査法人グループにてAIおよび先端技術を活用した企業支援、産業支援に従事。

東北大学 特任教授、内閣府AI戦略専門調査会委員、日本ディープラーニング協会 顧問。

著訳書に、『ウェブ大変化 パワーシフトの始まり』(近代セールス社)、『グローバルAI活用企業動向調査 第5版』(共訳、デロイト トーマツ社)、『信頼できるAIへのアプローチ』(監訳、共立出版)など多数。